近期,大型语言模型(LLMs)在人工智能社区引起了轰动,归功于其出色的能力和性能。这些模型在几乎所有基于AI子领域的行业中展现出了非凡的应用,包括自然语言处理、自然语言生成和计算机视觉。尽管计算机视觉,尤其是扩散模型引起了极大关注,但仍然存在使用有限输入生成高保真、连贯新视角的挑战。

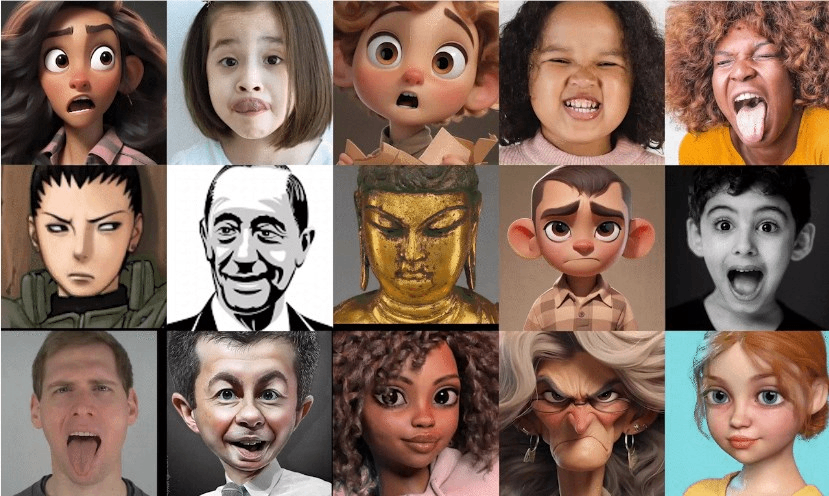

为了应对这一挑战,字节跳动的研究团队最近推出了DiffPortrait3D,这是一种独特的条件扩散模型,旨在从一张野外拍摄的肖像中创建逼真的、3D一致的视图。DiffPortrait3D可以将一张二维(2D)非受限制的肖像重建为人脸的三维(3D)表示。

简单来说,给定一张彩色照片作为输入,该项目的目标是合成具有保持身份和面部表情的合理但一致的面部细节,以新的相机视角呈现出来。与耗时的优化和微调不同,这种零样本方法能够很好地推广到具有不规定相机视角、极端面部表情和多样艺术描绘的任意人脸肖像。其核心思想是利用在大规模图像数据集上预训练的2D扩散模型作为渲染骨架,同时使用解耦的关注控制外观和相机姿势的去噪引导。

为了实现这一点,首先将参考图像的外观上下文注入到冻结的UNets的自注意层中。然后,使用一个新颖的条件控制模块来解释相机姿势,该模块通过观察来自相同视角的一个交叉主体的条件图像。此外,研究人员插入一个可训练的跨视图注意模块来增强视图一致性,这进一步通过推断期间的新颖3D感知噪声生成过程得以加强。

DiffPortrait3D使用特殊的条件控制模块来改变渲染视图。该模块分析从相同角度拍摄的主体的条件图像,以解释相机的态度。这使得模型能够从不同视角结合一致的面部特征。

为了进一步提高视觉一致性,还引入了一个可训练的交叉视图注意力模块。在面对严重的面部表情或不定姿态的相机视角可能导致困难的情况下,这个模块尤其有帮助。

为了确保推理过程的弹性,还包括了一种独特的3D感知噪声生成机制。这一阶段增加了合成图像的整体稳定性和逼真感。团队在严格的多视角和野外基准测试上评估了DiffPortrait3D的性能,展示了在各种艺术风格和环境设置下产生逼真高质量面部重建的最新成果。

该技术主要特点包括:

1. 引入了一种独特的零样本方法,通过扩展2D稳定扩散,从单一肖像创建3D一致的新视图。

2. 该方法在独特视图合成方面取得了令人印象深刻的成就,支持外观、表情、态度和风格各异的肖像,无需繁琐的微调。

3. 使用明确分离的外观和相机视图控制系统,实现了有效的相机操作,而不影响主体的表情或身份。

4. 该方法结合了交叉视图注意力模块和3D感知噪声生成技术,提供了3D视图的长程一致性。

项目网址:https://github.com/FreedomGu/DiffPortrait3D

本文来源于#站长之家,由@tom 整理发布。如若内容造成侵权/违法违规/事实不符,请联系本站客服处理!

该文章观点仅代表作者本人,不代表本站立场。本站不承担相关法律责任。

如若转载,请注明出处:https://www.zhanid.com/news/377.html