还在为短视频配音效抓耳挠腮?还在苦苦寻找合适的BGM却总是差强人意?现在,字节跳动直接放出王炸级AI黑科技,一举打破视频创作的最后一道静音魔咒!他们最新推出的SeedFoley音效生成模型,如同为视频注入了声命之魂,只需轻轻一点,就能为你的视频智能匹配专业级音效,瞬间让你的作品从默片变身有声大片,效果堪称惊艳!更令人振奋的是,这项AI音效神技已火速上线字节跳动旗下视频创作平台即梦,人人都能秒速体验一键音效加持的神奇魔力!

SeedFoley究竟是如何做到如此声入人心的?其核心奥秘在于它采用了革命性的端到端架构,如同一个精密的声音魔术师,巧妙地融合了视频的时空特征与强大的扩散生成模型,实现了音效与视频内容的高度同步和完美契合。简单来说,SeedFoley首先会对视频进行抽帧分析,就像给视频做CT扫描一样,提取出每一帧画面的关键信息,再通过一个视频编码器深度解读视频内容,理解视频中发生了什么,然后将这些视频理解投射到条件空间,为后续的音效生成指明方向。在音效生成的高速公路上,SeedFoley采用了改进的扩散模型框架,如同拥有无限创意的声音设计师,根据视频内容,智能生成与之完美匹配的音效方案。

为了让AI更懂声音的艺术,SeedFoley在训练过程中还学习了大量的语音和音乐相关标签,就像给AI配备了声音百科全书,让它能够区分音效和非音效,实现更精准的音效生成。更厉害的是,SeedFoley还是一位全能选手,能够处理各种长度的视频输入,无论你的视频是几秒的精彩瞬间,还是几分钟的完整故事,它都能轻松应对,并且在音效的准确性、同步性以及与视频内容的匹配度上,都达到了行业领先水平。

SeedFoley的视频编码器也暗藏玄机,它采用了快慢特征组合的独门秘籍,在高帧率下捕捉视频中细微的局部运动信息,就像鹰眼一样精准捕捉动作细节,在低帧率下则着重提取视频的语义信息,理解视频的故事内核,快慢特征双剑合璧,既保留了关键的运动特征,又有效降低了计算成本,实现了低功耗,高性能的完美平衡。

这种快慢结合的方式,让SeedFoley能够在低计算资源下,实现惊人的8fps帧级别视频特征提取,精准定位视频中的每一个细微动作,最终通过Transformer结构融合快慢特征,深度挖掘视频的时空奥秘。为了进一步提升训练效果和效率,SeedFoley还巧妙地在一个批次中引入多个困难样本,就像给AI设置了进阶挑战,显著提升了语义对齐效果,同时使用了sigmoidloss而非softmaxloss,在更低的资源消耗下,实现了媲美大批次训练的惊人效果。

在音频表征模型方面,SeedFoley同样别出心裁。与传统的VAE模型通常采用梅尔频谱(mel-spectrum)作为音频特征编码不同,SeedFoley大胆采用了原始波形(rawwaveform)作为输入,就像直接聆听声音的原始形态,经过编码后得到1D的音频表征,这种方式相比传统的mel-VAE模型,在音频的重构和生成建模上更具优势。为了确保高频信息的完整保留,SeedFoley的音频采样率高达32k,每秒钟的音频能够提取到32个音频潜在表征,有效提升了音频在时序上的分辨率,让生成的音效更加细腻逼真,如同天籁之音。

SeedFoley的音频表征模型还采用了两阶段联合训练策略,如同双管齐下,在第一阶段,使用掩码策略,剥离音频表征中的相位信息,将去相位后的潜在表征作为扩散模型的优化目标,就像先解构声音的结构,再进行重塑;在第二阶段,则使用音频解码器从去相位表征中重建相位信息,如同妙手回春,将声音还原到最真实的状态。这种分步走的策略,有效降低了扩散模型对表征的预测难度,最终实现了高质量音频潜在表征的生成和还原。

在扩散模型方面,SeedFoley选择了DiffusionTransformer框架,通过优化概率路径上的连续映射关系,实现了从高斯噪声分布到目标音频表征空间的概率精准匹配,如同在茫茫噪声中找到目标声音的正确路径。相较于传统扩散模型依赖马尔可夫链式采样的特性,SeedFoley通过构建连续变换路径,有效减少了推理步数,大幅降低了推理成本,让音效生成速度更快,效率更高。在训练阶段,SeedFoley将视频特征与音频语义标签分别编码为隐空间向量,如同将视频和音频信息翻译成AI能够理解的语言,再通过通道维度拼接(Channel-wiseConcatenation)将二者与时间编码(TimeEmbedding)及噪声信号进行混合,形成联合条件输入,就像将视频、音频和时间信息融合在一起,让AI能够更全面地理解视频内容,生成更精准的音效。

这种巧妙的设计,通过显式建模跨模态时序相关性,有效提升了音效和视频画面在时序上的一致性以及内容的理解能力。在推理阶段,用户还可以通过调整CFG系数,灵活调整视觉信息的控制强度以及生成质量之间的平衡,就像拥有了音效调音台,可以根据需求自由调整音效风格。通过迭代式优化噪声分布,SeedFoley将噪声逐步转换为目标数据分布,最终生成高质量的音效音频。为了避免音效中混入不必要的人声或背景音乐,SeedFoley还能够通过将人声以及音乐标签进行强制设定,如同给音效划定界限,有效提升音效的清晰度和质感。最后,将音频表征输入到音频解码器中,就能得到最终的完美音效。

总而言之,SeedFoley的诞生,标志着视频内容与音频生成实现了深度融合,它能够精准提取视频帧级视觉信息,通过洞察多帧画面信息,精准识别视频中的发声主体及动作场景,无论是节奏感强烈的音乐瞬间,还是电影中的紧张情节,SeedFoley都能精准卡点,营造出身临其境的逼真体验。更令人惊喜的是,SeedFoley还能智能区分动作音效和环境音效,如同声音界的艺术家,显著提升视频的叙事张力和情感传递效率,让你的视频作品更具感染力。

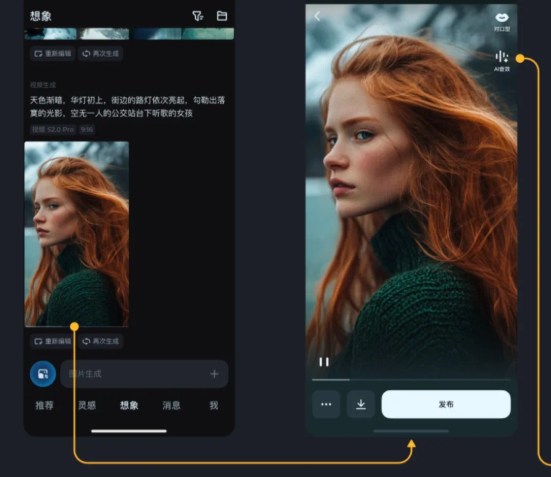

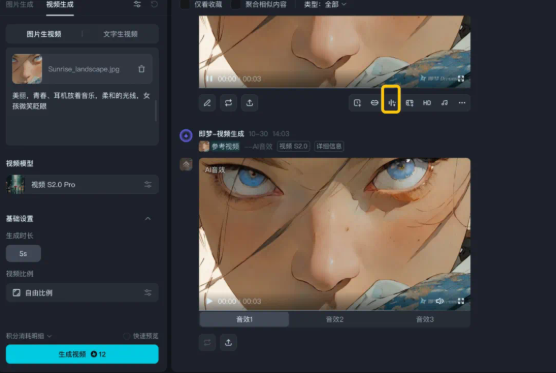

现在,AI音效功能已正式上线即梦平台,用户只需使用即梦生成视频后,选择AI音效功能,即可一键生成3个专业级音效方案,轻松摆脱AI视频的无声尴尬,在AI视频创作、生活Vlog、短片制作和游戏制作等高频场景中,都能便捷地制作出配有专业音效的高质量视频,让你的视频作品瞬间声动起来!

本文来源于#站长之家,由@tom 整理发布。如若内容造成侵权/违法违规/事实不符,请联系本站客服处理!

该文章观点仅代表作者本人,不代表本站立场。本站不承担相关法律责任。

如若转载,请注明出处:https://www.zhanid.com/news/3524.html